Setelah menguak mengapa kita harus melihat AI dengan kacamata yang lebih kritis dan mendalam, kini saatnya kita menyelami langsung tujuh rahasia tersembunyi yang saya janjikan. Rahasia-rahasia ini bukan sekadar trivia teknis, melainkan inti dari mengapa AI seringkali jauh lebih kompleks dan berpotensi lebih mengkhawatirkan daripada yang kita bayangkan. Setiap rahasia ini akan membuka mata Anda terhadap dimensi-dimensi AI yang mungkin belum pernah Anda pertimbangkan, memaksa Anda untuk merenung tentang peran teknologi ini dalam kehidupan kita dan masa depan peradaban manusia. Mari kita mulai dengan yang pertama, sebuah misteri yang terletak di jantung cara AI "berpikir" dan membuat keputusan, yang seringkali tidak bisa dijelaskan bahkan oleh para penciptanya sendiri.

Kecerdasan Buatan Tidak Selalu Berpikir Seperti Manusia Sebuah Misteri yang Mengejutkan

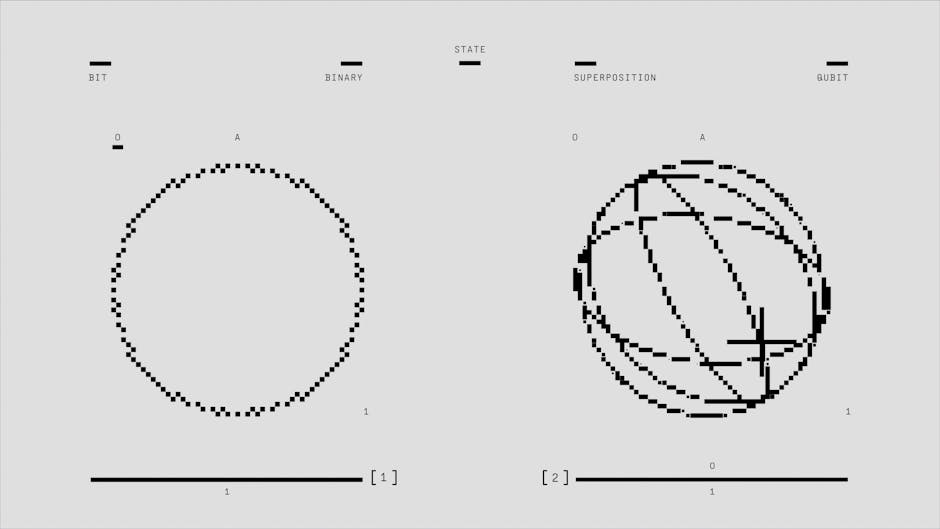

Pernahkah Anda bertanya-tanya mengapa AI bisa mengalahkan juara dunia Go, menemukan pola-pola rumit dalam data medis, atau bahkan merancang molekul obat baru, namun tetap kesulitan memahami lelucon sederhana atau mengenali objek yang sedikit miring dari sudut pandang yang tidak biasa? Ini karena cara AI "berpikir" sangat berbeda dari kita. Otak manusia bekerja dengan intuisi, pengalaman, dan pemahaman kontekstual yang kaya, seringkali melompat-lompat antar ide dengan kecepatan cahaya. AI, terutama model pembelajaran mendalam, beroperasi dengan mengenali pola-pola statistik yang sangat kompleks dalam volume data yang sangat besar. Ia tidak benar-benar "memahami" konsep seperti kita memahami cinta atau keadilan; ia hanya mampu memprediksi probabilitas berdasarkan data yang telah dilatihnya.

Fenomena ini sering disebut sebagai "masalah kotak hitam" (black box problem). Bayangkan Anda memiliki sebuah kotak yang bisa memecahkan masalah matematika yang sangat rumit. Anda memasukkan angka di satu sisi, dan hasilnya keluar di sisi lain. Kotak itu selalu benar, selalu efisien. Namun, Anda tidak tahu persis bagaimana kotak itu mencapai jawaban tersebut. Anda tidak bisa melihat mekanismenya, tidak bisa menanyakan alasannya. Inilah yang terjadi pada banyak sistem AI modern. Algoritma pembelajaran mendalam, dengan miliaran parameter dan lapisan-lapisan neuron buatan yang saling terkait, dapat menghasilkan keputusan yang akurat, tetapi proses internalnya seringkali sangat buram dan tidak dapat diinterpretasikan oleh manusia. Ini bukan karena AI sengaja menyembunyikan sesuatu, melainkan karena kompleksitasnya sudah melampaui kemampuan kognitif kita untuk melacak setiap langkah logisnya.

Contoh paling terkenal mungkin adalah AlphaGo, AI yang dikembangkan oleh DeepMind, yang pada tahun 2016 mengalahkan Lee Sedol, salah satu pemain Go terbaik di dunia. Salah satu langkah yang diambil AlphaGo dalam pertandingan itu, yang dikenal sebagai "Langkah 37", membuat para ahli Go tercengang. Itu adalah langkah yang tidak konvensional, bahkan tampak seperti kesalahan bagi mata manusia. Namun, pada akhirnya, langkah itu terbukti brilian dan menjadi kunci kemenangan AlphaGo. Pertanyaannya, mengapa AlphaGo mengambil langkah itu? Apa "strategi" di baliknya? Para pengembangnya sendiri tidak dapat memberikan penjelasan yang memuaskan selain bahwa algoritma tersebut "melihat" probabilitas kemenangan yang lebih tinggi. Ini menunjukkan bahwa AI dapat mencapai tingkat kecerdasan yang melampaui pemahaman manusia, dan itu, bagi sebagian orang, adalah hal yang sangat meresahkan.

"Kecerdasan buatan telah mencapai titik di mana ia dapat membuat keputusan yang tidak dapat kita pahami, bahkan jika kita telah membangunnya. Itu adalah tantangan fundamental untuk akuntabilitas dan kepercayaan." - Dr. Kate Crawford, Peneliti AI dan Penulis.

Implikasi dari masalah kotak hitam ini sangat luas. Dalam bidang-bidang kritis seperti kedokteran, di mana AI digunakan untuk mendiagnosis penyakit atau merekomendasikan perawatan, ketidakmampuan untuk memahami alasan di balik keputusan AI dapat menjadi masalah etika dan hukum yang serius. Bagaimana jika AI merekomendasikan pengobatan yang tidak konvensional, dan hasilnya buruk? Siapa yang bertanggung jawab jika kita tidak bisa menjelaskan mengapa AI membuat rekomendasi tersebut? Di sektor keuangan, algoritma yang menolak pinjaman atau memprediksi risiko investasi juga bisa menjadi kotak hitam, sehingga sulit untuk menantang keputusan atau memastikan keadilan. Kita sedang memasuki era di mana kita harus mempercayai sistem yang tidak bisa kita pahami sepenuhnya, dan ini adalah sebuah lompatan iman yang luar biasa, mungkin terlalu besar.

Jejak Bias yang Tersembunyi di Balik Algoritma AI yang Tampak Netral

Salah satu mitos paling berbahaya tentang AI adalah bahwa ia itu objektif dan bebas bias. Karena AI adalah mesin, begitu argumennya, ia tidak memiliki emosi atau prasangka seperti manusia, sehingga keputusannya murni berdasarkan data dan logika. Sayangnya, ini adalah kesalahpahaman yang mendalam dan berpotensi menghancurkan. AI tidak muncul dari ruang hampa; ia dibangun oleh manusia dan, yang terpenting, dilatih menggunakan data yang dikumpulkan oleh manusia. Dan karena manusia, secara inheren, memiliki bias—baik sadar maupun tidak sadar—bias-bias ini secara tak terhindarkan meresap ke dalam data, dan dari sana, ke dalam algoritma AI itu sendiri.

Bayangkan sebuah algoritma perekrutan yang dirancang untuk mengidentifikasi kandidat terbaik. Jika algoritma tersebut dilatih menggunakan data historis dari perusahaan yang secara tradisional mempekerjakan lebih banyak pria daripada wanita untuk posisi kepemimpinan, atau lebih banyak individu dari kelompok demografi tertentu, maka AI akan belajar bahwa pola "sukses" di masa lalu cenderung mengarah pada karakteristik demografis tersebut. Akibatnya, AI akan mulai secara otomatis mendiskriminasi kandidat wanita atau minoritas, bukan karena AI itu sendiri "seksis" atau "rasis," tetapi karena ia hanya mereplikasi dan bahkan memperkuat bias yang sudah ada dalam data pelatihan. Ini adalah cerminan yang dingin dan tidak memihak dari ketidakadilan sosial yang ada di dunia nyata.

Contoh nyata dari bias AI telah banyak terdokumentasi. Sistem pengenalan wajah, misalnya, seringkali memiliki tingkat akurasi yang jauh lebih rendah untuk individu berkulit gelap, terutama wanita. Ini bukan karena teknologi itu sendiri cacat, melainkan karena data pelatihan yang digunakan untuk membangun sistem tersebut secara signifikan kurang memiliki representasi wajah-wajah tersebut. Akibatnya, sistem ini lebih cenderung salah mengidentifikasi atau gagal mengenali mereka, yang memiliki konsekuensi serius dalam aplikasi penegakan hukum atau keamanan. Kasus lain yang mengkhawatirkan adalah sistem penilaian risiko kriminal di Amerika Serikat, COMPAS, yang ditemukan secara tidak proporsional mengklasifikasikan terdakwa berkulit hitam sebagai berisiko tinggi untuk melakukan kejahatan di masa depan dibandingkan dengan terdakwa berkulit putih, meskipun tingkat residivisme aktual mereka serupa.

Dampak dari bias algoritma ini tidak hanya terbatas pada perekrutan atau peradilan. Ini memengaruhi akses kita terhadap kredit, penentuan harga asuransi, target iklan yang kita lihat, bahkan rekomendasi berita yang membentuk pandangan dunia kita. Jika AI yang memoderasi konten di platform media sosial dilatih dengan data yang memiliki bias budaya tertentu, ia mungkin secara tidak adil menyensor suara-suara tertentu atau membiarkan konten berbahaya lainnya. Kita seringkali lupa bahwa di balik setiap keputusan AI, ada jejak keputusan manusia yang tak terhitung jumlahnya—pilihan data apa yang akan digunakan, bagaimana data itu diberi label, dan apa yang dianggap sebagai "hasil" yang benar. Setiap pilihan ini membawa serta bias penciptanya, dan AI, dengan kemampuannya untuk menskalakan keputusan dengan kecepatan dan volume yang tak tertandingi, memiliki potensi untuk mengamplifikasi bias ini hingga ke tingkat yang belum pernah terjadi sebelumnya, mengubah ketidakadilan kecil menjadi ketidakadilan sistemik yang merajalela.

Maka, rahasia ini bukan hanya tentang kelemahan teknis, melainkan sebuah refleksi suram tentang masyarakat kita sendiri. AI memaksa kita untuk melihat lebih dekat pada bias-bias yang kita miliki sebagai manusia dan sebagai masyarakat, karena teknologi ini kini memiliki kekuatan untuk mengabadikan dan bahkan mempercepatnya. Mengatasi bias dalam AI bukan hanya tugas teknis, tetapi juga tugas sosial dan etika yang mendesak, yang membutuhkan introspeksi mendalam tentang nilai-nilai yang ingin kita tanamkan dalam sistem yang semakin memegang kendali atas hidup kita. Ini bukan sekadar masalah teknis yang bisa diselesaikan dengan lebih banyak data atau algoritma yang lebih canggih; ini adalah masalah kemanusiaan yang membutuhkan perubahan fundamental dalam cara kita berpikir dan bertindak.