Melanjutkan pembahasan mengenai bahaya penggunaan AI tanpa pemahaman yang memadai, kita seringkali tergelincir pada kesalahan-kesalahan yang fundamental, namun dampaknya bisa sangat merusak. Setelah mengulas tentang bahaya menganggap AI sebagai entitas mahatahu dan pentingnya memberikan perintah yang spesifik, kini saatnya kita masuk lebih dalam ke tiga kesalahan fatal lainnya yang seringkali menjadi jurang kegagalan bagi para pengguna AI. Ingat, tujuan kita bukan untuk menakut-nakuti, melainkan untuk membekali Anda dengan pengetahuan yang solid agar dapat memanfaatkan AI secara cerdas, etis, dan efektif. Ini adalah tentang mengubah potensi 'zonk total' menjadi 'sukses maksimal'. Mari kita selami lebih jauh.

Mengabaikan Etika dan Bias Data dalam Penggunaan Kecerdasan Buatan

Salah satu aspek paling krusial dan sering diabaikan dalam penggunaan AI adalah dimensi etika dan potensi bias data yang melekat di dalamnya. Banyak pengguna, dengan semangat ingin memanfaatkan teknologi terbaru, lupa bahwa AI dibangun di atas data yang dikumpulkan dan diproses oleh manusia, dan data tersebut seringkali mencerminkan bias, prasangka, atau ketidakadilan yang ada di masyarakat. Ketika sebuah model AI dilatih dengan data yang bias, ia tidak hanya akan mereplikasi bias tersebut, tetapi bahkan bisa memperkuatnya dalam output yang dihasilkannya. Ini bukan lagi sekadar masalah akurasi; ini adalah masalah keadilan sosial, diskriminasi, dan potensi kerugian serius bagi individu atau kelompok tertentu. Mengabaikan aspek ini sama dengan membangun sistem yang secara inheren tidak adil, yang bisa berujung pada konsekuensi hukum, reputasi buruk, dan hilangnya kepercayaan publik.

Saya pernah membaca kasus yang cukup menghebohkan di Amerika Serikat, di mana sebuah sistem AI yang digunakan untuk menilai risiko residivisme (kemungkinan seseorang melakukan kejahatan lagi setelah dibebaskan) ternyata secara konsisten memberikan skor risiko yang lebih tinggi kepada individu berkulit hitam dibandingkan individu berkulit putih, meskipun dengan catatan kriminal yang serupa. Investigasi menunjukkan bahwa bias ini berasal dari data pelatihan historis yang mencerminkan bias sistem peradilan di masa lalu. Hasilnya, sistem AI tersebut justru memperpetasikan diskriminasi rasial, bukan membantu keadilan. Ini adalah contoh nyata bagaimana bias data dapat memiliki dampak yang merusak pada kehidupan nyata. Dalam konteks yang lebih ringan, namun tetap penting, misalnya dalam rekrutmen karyawan. Jika AI pelamar dilatih dengan data rekrutmen historis yang cenderung memilih kandidat pria untuk posisi kepemimpinan, AI tersebut mungkin akan secara tidak sadar mendiskriminasi kandidat wanita yang sebenarnya sangat berkualitas. Menurut laporan dari World Economic Forum, mengatasi bias dalam AI adalah salah satu tantangan etika terbesar di era digital, menuntut pendekatan multidisiplin dari para pengembang, regulator, dan pengguna. Sebagai pengguna AI, kita memiliki tanggung jawab moral untuk tidak hanya memahami potensi bias ini, tetapi juga mengambil langkah proaktif untuk memitigasinya, baik dengan memilih sumber data yang lebih beragam, melakukan audit rutin terhadap output AI, maupun menggunakan AI sebagai alat bantu saja, bukan sebagai penentu keputusan akhir yang mutlak.

Memastikan Keadilan Algoritma dan Mengurangi Bias yang Tersembunyi

Langkah konkret untuk mengatasi bias data adalah dengan memahami bahwa AI bukanlah entitas netral. Setiap algoritma, setiap model, adalah cerminan dari data yang melatihnya dan keputusan yang dibuat oleh para pengembangnya. Oleh karena itu, tugas kita sebagai pengguna adalah menjadi 'penjaga gerbang' yang kritis. Ini berarti tidak hanya menerima output AI begitu saja, tetapi juga mempertanyakan sumber datanya, memahami konteks di mana model itu dilatih, dan secara aktif mencari potensi bias. Misalnya, jika Anda menggunakan AI untuk menganalisis sentimen media sosial, Anda harus sadar bahwa AI mungkin tidak sepenuhnya memahami nuansa bahasa, sarkasme, atau dialek lokal yang berbeda, yang bisa menyebabkan interpretasi sentimen yang salah dan bias. Ini bukan hanya tentang keakuratan teknis, tetapi juga tentang kepekaan budaya dan sosial. Saya pernah berinteraksi dengan sebuah startup yang mengembangkan AI untuk personalisasi rekomendasi produk. Mereka awalnya melatih model dengan data demografi yang sangat terbatas, yang menyebabkan rekomendasi mereka terasa sangat stereotip dan bahkan ofensif bagi beberapa kelompok pengguna. Setelah menyadari kesalahan ini, mereka berinvestasi besar dalam mengumpulkan data yang jauh lebih beragam dan melakukan pengujian yang ketat untuk mengidentifikasi dan mengurangi bias algoritmik. Hasilnya, rekomendasi produk mereka menjadi jauh lebih relevan, inklusif, dan diterima oleh berbagai segmen pelanggan.

"Kecerdasan buatan hanyalah cermin dari kecerdasan manusia yang menciptakannya. Jika cermin itu bengkok, pantulannya pun akan bengkok." - Dr. Safiya Umoja Noble, Penulis 'Algorithms of Oppression'

Pendekatan etis terhadap AI juga mencakup pertimbangan privasi dan keamanan data. Ketika Anda memasukkan informasi sensitif ke dalam model AI, apakah Anda yakin data tersebut akan ditangani dengan aman? Apakah ada risiko data Anda digunakan untuk tujuan yang tidak Anda setujui? Pertanyaan-pertanyaan ini menjadi semakin relevan dengan meningkatnya insiden pelanggaran data. Perusahaan yang menggunakan AI untuk memproses data pelanggan harus memastikan kepatuhan terhadap regulasi privasi seperti GDPR atau UU Perlindungan Data Pribadi di Indonesia. Gagal melakukannya tidak hanya akan merusak kepercayaan pelanggan, tetapi juga dapat berujung pada denda yang sangat besar. Mengintegrasikan prinsip 'privasi sejak desain' (privacy by design) dalam setiap implementasi AI adalah langkah yang tidak bisa ditawar lagi. Ini berarti, sejak awal pengembangan atau penggunaan AI, pertimbangan privasi harus menjadi prioritas utama, bukan sekadar tambahan setelah semuanya selesai. Ini termasuk enkripsi data, anonimisasi, dan kontrol akses yang ketat. Mengabaikan etika dan bias data dalam AI bukan hanya tidak bertanggung jawab, tetapi juga merupakan resep untuk bencana reputasi dan finansial yang bisa dihindari.

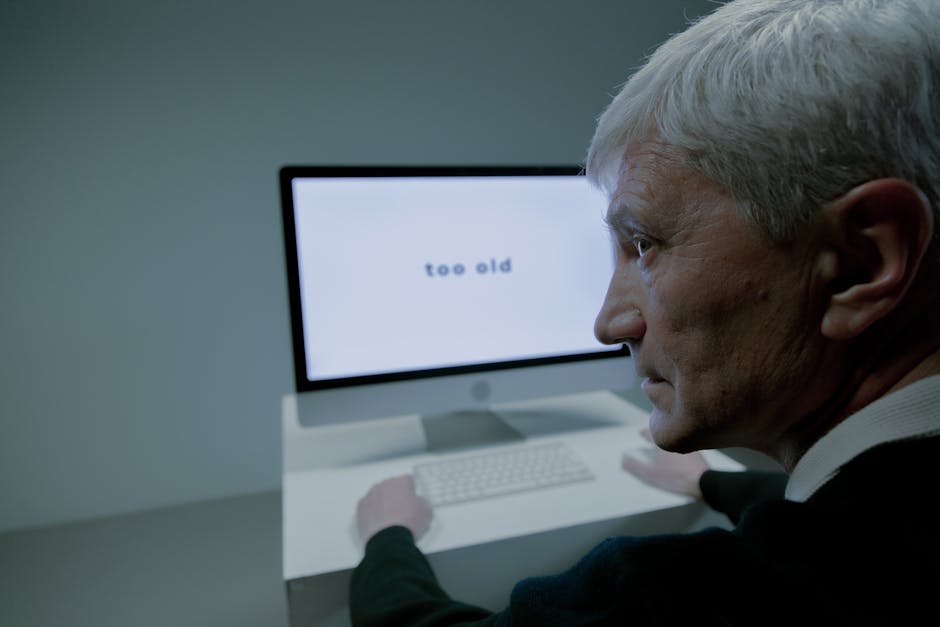

Ketergantungan Berlebihan pada AI untuk Tugas Kritis yang Membutuhkan Nuansa Manusia

Kesalahan fatal ketiga adalah ketergantungan yang berlebihan pada AI untuk tugas-tugas yang secara intrinsik membutuhkan penilaian manusia, empati, kreativitas orisinal, atau pemahaman kontekstual yang mendalam. AI adalah alat yang luar biasa untuk mengotomatisasi, menganalisis, dan bahkan menghasilkan, tetapi ia bukanlah pengganti sepenuhnya untuk kecerdasan emosional, intuisi, atau kapasitas manusia untuk berpikir di luar kotak dan memahami nuansa yang kompleks. Ketika kita mendelegasikan tugas-tugas kritis seperti pengambilan keputusan strategis, konsultasi psikologis, penulisan kreatif yang membutuhkan jiwa, atau bahkan diagnosis medis tanpa pengawasan manusia yang memadai, kita sedang bermain api. Risiko kesalahan, misinterpretasi, atau hilangnya sentuhan manusiawi yang esensial menjadi sangat tinggi, dan konsekuensinya bisa sangat merugikan.

Saya pernah mendengar cerita tentang sebuah perusahaan yang mencoba menggunakan AI untuk menangani seluruh layanan pelanggan mereka, termasuk keluhan yang sensitif dan kompleks. AI memang efisien dalam menjawab pertanyaan rutin, tetapi ketika dihadapkan pada pelanggan yang frustrasi, marah, atau membutuhkan solusi yang disesuaikan dengan situasi unik mereka, AI seringkali gagal total. Responnya terasa dingin, generik, dan tidak empatik, yang justru memperburuk situasi dan membuat pelanggan semakin kecewa. Akibatnya, perusahaan tersebut kehilangan banyak pelanggan setia dan reputasi mereka di mata publik menurun drastis. Ini menunjukkan bahwa meskipun AI dapat mengelola volume interaksi yang besar, ia tidak bisa menggantikan empati dan kemampuan manusia untuk mendengarkan, memahami, dan merespons dengan kehangatan. Dalam bidang medis, meskipun AI telah menunjukkan potensi besar dalam membantu diagnosis, dokter manusia tetap krusial untuk menginterpretasikan hasil, mempertimbangkan riwayat pasien yang kompleks, dan berkomunikasi dengan empati tentang rencana perawatan. Sebuah laporan dari McKinsey menegaskan bahwa kolaborasi manusia-AI adalah model paling efektif, di mana AI menangani tugas-tugas komputasi intensif dan manusia fokus pada pengambilan keputusan bernuansa dan interaksi yang membutuhkan kecerdasan emosional.

Menjaga Keseimbangan antara Otomatisasi dan Sentuhan Manusia

Kunci untuk menghindari ketergantungan berlebihan ini adalah dengan memahami kapan AI menjadi aset dan kapan ia menjadi kewajiban. AI sangat cocok untuk tugas-tugas yang bersifat repetitif, berbasis data, atau membutuhkan kecepatan pemrosesan yang tinggi. Misalnya, menganalisis jutaan baris data, menyusun draf awal laporan, atau mengotomatisasi proses pengisian formulir. Namun, ketika tugas tersebut melibatkan kreativitas orisinal yang mendalam, pengambilan keputusan etis, negosiasi interpersonal, atau pemahaman emosi manusia, peran manusia menjadi tak tergantikan. AI dapat menjadi asisten yang brilian, seorang 'co-pilot' yang membantu Anda terbang lebih tinggi, tetapi kemudi utama tetap harus dipegang oleh manusia. Saya sering menyarankan kepada klien saya untuk menerapkan model 'human-in-the-loop' (manusia dalam lingkaran) dalam penggunaan AI, terutama untuk tugas-tugas kritis. Ini berarti bahwa meskipun AI melakukan sebagian besar pekerjaan, ada titik-titik pemeriksaan di mana manusia harus meninjau, memvalidasi, mengedit, atau mengambil alih kendali. Misalnya, AI dapat menulis draf awal sebuah cerita, tetapi penulis manusia yang akan memberikan jiwa, emosi, dan gaya unik yang membuat cerita itu benar-benar hidup. AI bisa menganalisis data keuangan, tetapi seorang penasihat keuangan yang berpengalamanlah yang akan memberikan saran yang disesuaikan dengan situasi dan tujuan hidup klien.

Membangun keahlian dalam mengenali batasan AI adalah keterampilan vital di era ini. Ini bukan hanya tentang mengetahui apa yang AI bisa lakukan, tetapi lebih penting lagi, apa yang AI *tidak bisa* lakukan (atau belum bisa lakukan dengan baik). Ini membutuhkan pemahaman kritis tentang teknologi itu sendiri, serta pemahaman yang mendalam tentang domain pekerjaan Anda. Misalnya, seorang pengacara yang menggunakan AI untuk riset hukum harus tahu bahwa AI mungkin tidak memahami preseden hukum yang sangat spesifik atau nuansa interpretasi undang-undang yang memerlukan pengalaman bertahun-tahun. Oleh karena itu, output AI harus selalu diperiksa oleh pengacara manusia yang memiliki keahlian dan lisensi. Mengandalkan AI secara membabi buta untuk tugas-tugas kritis bukan hanya tidak profesional, tetapi juga berpotensi menimbulkan risiko hukum dan etika yang serius. Ingatlah, AI adalah alat untuk memperkuat kemampuan manusia, bukan untuk menggantikannya. Keseimbangan ini adalah esensi dari pemanfaatan AI yang cerdas dan bertanggung jawab, dan mengabaikannya akan membawa Anda pada kegagalan yang tidak perlu.

Gagal Beradaptasi dan Belajar dari Interaksi dengan Kecerdasan Buatan

Kesalahan kelima yang sering saya amati adalah kegagalan untuk beradaptasi dan belajar secara berkelanjutan dari interaksi kita dengan AI. Banyak pengguna yang memperlakukan AI sebagai kotak hitam ajaib; mereka memasukkan prompt, mendapatkan output, dan kemudian mengulanginya tanpa pernah menganalisis mengapa output tertentu baik atau buruk, atau bagaimana mereka bisa meningkatkan interaksi mereka di masa depan. Ini adalah pola pikir statis yang sangat merugikan di dunia AI yang terus berkembang pesat. AI itu sendiri adalah sistem pembelajaran, dan kita sebagai penggunanya juga harus menjadi pembelajar yang adaptif. Jika kita tidak belajar bagaimana berkomunikasi lebih efektif dengan AI, bagaimana memahami batasan dan kemampuannya yang terus berubah, kita akan selalu terjebak dalam siklus hasil yang medioker atau bahkan gagal total. Dunia AI bukanlah tempat untuk mereka yang malas belajar dan beradaptasi.

Saya pernah bekerja dengan sebuah tim editorial yang mencoba menggunakan AI untuk menyusun ringkasan berita harian. Awalnya, hasilnya sangat tidak memuaskan; ringkasan terasa kering, tidak kohesif, dan sering melewatkan poin-poin penting. Tim tersebut hampir menyerah, menganggap AI tidak berguna. Namun, salah satu editor yang lebih proaktif memutuskan untuk bereksperimen. Ia mulai mencatat jenis prompt yang menghasilkan ringkasan yang lebih baik, ia mencoba berbagai gaya bahasa, dan ia bahkan mulai memberikan contoh-contoh ringkasan yang ia sukai agar AI bisa 'belajar' dari preferensinya. Perlahan tapi pasti, kualitas ringkasan yang dihasilkan AI meningkat secara dramatis. Editor tersebut tidak hanya mendapatkan output yang lebih baik, tetapi ia juga mengembangkan keterampilan baru dalam 'prompt engineering' yang sangat berharga. Ini adalah contoh sempurna dari mentalitas pertumbuhan yang diperlukan dalam era AI. Menurut sebuah laporan dari IBM, 'literasi AI' bukan hanya tentang memahami apa itu AI, tetapi juga tentang mengembangkan keterampilan untuk berinteraksi dengannya secara efektif, yang meliputi kemampuan untuk mengadaptasi pendekatan seseorang berdasarkan umpan balik dan hasil. Gagal untuk beradaptasi dan belajar dari setiap interaksi dengan AI sama saja dengan menolak untuk menguasai alat yang ada di tangan Anda, dan pada akhirnya, Anda akan tertinggal jauh di belakang mereka yang proaktif dalam pembelajaran.